🔎 Microsofts verktyg avslöjar deepfakes

Genom att analysera detaljer som är omöjliga för ögat att upptäcka kan Microsofts AI-teknik ange sannolikheten för att filmer, foton och ljudinspelningar är förfalskade.

Dela artikeln

Deepfakes är falska videor, foton och ljudfiler som är väldigt svåra att skilja från äkta vara. De kan förstås göra problemet med desinformation värre än det redan är. Men Microsoft har byggt ett verktyg som ska hjälpa oss att sålla agnarna från vetet.

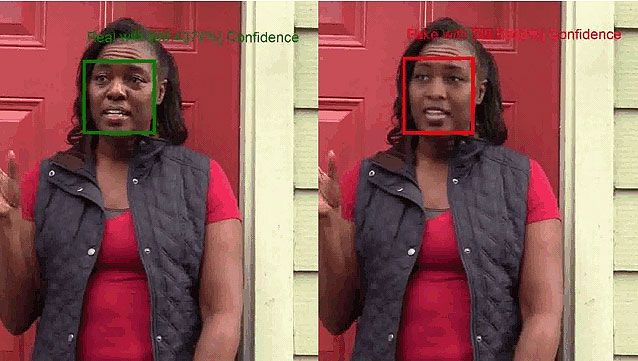

Microsoft Video Authenticator använder AI för att avgöra hur stor risken är att en video blivit manipulerad. Verktyget visar i realtid hur stor sannolikhet det är att någon manipulerat en bildruta i filmen. Så även om det bara är en väldigt liten del av videon som manipulerats kan Microsoft Video Authenticator ge tydligt besked om vilket parti i filmen som inte går att lita på.

För att angripa problemet från andra hållet har Microsoft även utvecklat en teknik där den som skapar en video ska kunna ge den en ”vattenstämpel”. Om något ändras i filen märks det direkt och webbläsare med mera kan lägga upp ett meddelande om att filmen förfalskats.

För den som vill lära sig mer om deepfakes har Microsoft tillsammans med bland andra USA Today skapat ett quiz. Här det går att se hur bra du är på att upptäcka deepfakes.